Biométrie dans l'espace public : le rapport du Sénat se veut rassurant mais laisse "des zones de flou"

Mercredi 11 mai à midi, la commission des Lois du Sénat tenait une conférence de presse pour la remise de son rapport sur "La reconnaissance biométrique dans l'espace public : 30 propositions pour écarter le risque d'une société de surveillance". Entre "les tenants d'un moratoire portant sur toutes les technologies biométriques", et "ceux qui mettent en exergue leurs importants bénéfices potentiels", les parlementaires font le vœu — pieux ? — de viser au milieu. Un numéro d'équilibriste qui, s'il est vendu comme étant bienveillant, repose essentiellement sur la bonne volonté de l'Union européenne et la mise en lumière de certaines "zones de flou". FranceSoir était présent :

Au @Senat, Arnaud de Belenet (Union centriste), @DAUBRESSE_MP (LR) et @Jeromedurain (socialiste) présentent les conclusions de leur rapport "La reconnaissance biométrique dans l’espace public : 30 propositions pour écarter le risque d’une société de surveillance". pic.twitter.com/B3IPgNcbLx

— FranceSoir (@france_soir) May 11, 2022

Surveiller la surveillance

Quand Marc-Philippe Daubresse (LR), Jérôme Durain (SER) et Arnaud de Belenet (UC) entament la présentation du rapport, ils insistent sur le fait que "les interdictions sont beaucoup plus nombreuses que les autorisations", ce qui devrait permettre d'éviter "la société à la chinoise". "Pas de capitalisme ni de contrôle social", assure Jérôme Durain, "ni d'usage dans les manifestations". Un exercice glissant qui ressemble à de la prétérition :

A quel moment on ne tient même plus compte de l'état de la grenouille que l'on fait bouillir...

— Ugo Bernalicis φ (@Ugobernalicis) May 12, 2022

Rien ne va dans ce rapport car son objectif est fixé à l'avance : faire en sorte d'ouvrir le marché de la reconnaissance faciale.#Sécurité #TechnoPolice #CyberSurveillance https://t.co/FjNTmjhZ52

Dans les grandes lignes, l'idée est tout de même de pouvoir recourir à la reconnaissance faciale en cas de force majeure, avec l'aval des services de renseignements ou de la justice. Pour "créer le débat" autour de ce sujet, les rapporteurs de la commission des Lois proposent l'adoption d'une "loi d'expérimentation" sur trois ans. Cette expérience, ils souhaitent l'encadrer, notamment avec des interdictions :

- Interdiction de la notation sociale. [...]

- Interdiction de la catégorisation d’individus en fonction de l’origine ethnique, du sexe, ou de l’orientation sexuelle, sauf dans le cadre de la recherche scientifique et sous réserve de garanties appropriées ;

- Interdiction de l’analyse d’émotions, sauf à des fins de santé ou de recherche scientifique et sous réserve de garanties appropriées ;

- Interdiction de la surveillance biométrique à distance en temps réel dans l’espace public, sauf exceptions très limitées au profit des forces de sécurité ; en particulier, cette interdiction porterait sur la surveillance biométrique à distance en temps réel lors de manifestations sur la voie publique et aux abords des lieux de culte.

Ils s'appuient sur trois grands principes :

- le principe de subsidiarité, pour que la reconnaissance biométrique ne soit utilisée que lorsqu’elle est vraiment nécessaire ;

- le principe d’un contrôle humain systématique afin qu’il ne s’agisse que d’une aide à la décision ;

- le principe de transparence pour que l’usage des technologies de reconnaissance biométrique ne se fasse pas à l’insu des personnes.

Le tout, emballé dans "un régime de contrôle a priori et a posteriori". C'est ici que la vision se trouble.

Du temps réel au temps long

A priori, ce sont les services de renseignements (DGSI) ou les juristes qui peuvent faire appel à l'utilisation de la surveillance biométrique, sous réserve de l'acceptation d'une autorité supérieure comme le ministère de l'Intérieur. Ce sont eux qui sont chargés de détecter si tel ou tel événement est "à risque" et doit être surveillé, ou pas. Les Jeux olympiques 2024, par exemple, semblent être dans la ligne de mire, bien que le gouvernement ait "écarté" cette idée en octobre 2021.

Ce sont les mêmes services de renseignements qui fourniraient aux logiciels — et algorithmes — les identités à surveiller en priorité. Systématiquement, les citoyens susceptibles de passer sous les radars seront prévenus et auront deux options : se rendre à l'endroit voulu en acceptant d'être filmé, ou ne pas y aller. Pour l'instant, aucun autre moyen d'opposition que l'abstention n'est prévu, ce qui aura possiblement pour effet d'écarter de la société certains citoyens réfractaires. Rien de neuf sous le soleil ! Le rapport prévoit même que "dans certains cas très particuliers et à titre expérimental, ces dispositifs pourraient être rendus possibles de manière obligatoire, pour accéder à des zones nécessitant une sécurisation exceptionnelle." Le décor planté, deux méthodes sont ensuite présentées : le temps réel et le fonctionnement a posteriori.

En temps réel, la surveillance devrait être limitée aux "cas graves", "aux grands événements" et aux "menaces imminentes". En état d'urgence permanent et en pleine guerre, cela paraît assez flou, mais le fonctionnement est clair : les services de renseignements indiquent le lieu et les personnes à surveiller, les caméras sont installées et les citoyens prévenus, l'événement se déroule — sous l'œil vigilant des caméras, et finalement, les données non utilisées sont "auto-détruites immédiatement", selon les sénateurs. Jérôme Durain et Marc-Philippe Deubresse nous expliquent que seules les personnes recherchées pourraient être identifiées, puisque n'ayant pas de fichiers, "les autres n'existent pas". Pour expliciter leur propos, ils nous assurent que le croisement des données entre les fichiers de reconnaissance faciale et ceux de l'assurance maladie ou autres dispositifs administratifs, c'est "hors de question". Gageons que le service gouvernemental France Connect ne soit pas utilisé en ce sens.

La seconde méthode repose sur des enquêtes menées a posteriori. Dans ce cas, ce sont les forces de l'ordre ou de renseignement qui peuvent demander à avoir accès aux données récoltées. Idem pour les enquêtes judiciaires et "la recherche d'auteurs ou de victimes des infractions les plus graves", notamment pour "reconstituer un parcours". C'est essentiellement ici que le bât blesse.

Voir aussi : "On a défendu les libertés" face à "un gouvernement de technocrates" Alain Houpert

"Des zones de flou" inquiétantes

Si des enquêtes ont effectivement lieu a posteriori, il faut nécessairement qu'une base de données soit alimentée et mise à disposition des autorités si besoin est. Autrement dit, il faut bien qu'à un moment ou à un autre, des gens soient filmés et que les données soient stockées. Non seulement cela met à mal la promesse de suppression automatique des données non utilisées, mais cela soulève de nombreuses questions : qui fournira et protègera cette base de données ? Le fabricant des dispositifs de surveillance, l'Union européenne, ou d'autres ? Pendant combien de temps ? Comment peut-on être assuré que dans ce laps de temps où les données sont conservées, elles ne pourront être utilisées à d'autres fins que celle de la sécurité ? Si les données personnelles ou comportementales — de navigation surtout — sont déjà utilisées (voire vendues) pour créer des profils de consommateurs à des fins commerciales, pourquoi les futures données biométriques ne le seraient-elles pas ? Pour alimenter les futurs métaverses tant attendus, par exemple ?

Si Marc-Philippe Daubresse commençait en promettant de ne pas faire "comme les Anglais", à savoir "expérimenter avant de légiférer", il avoue alors qu'il existe bien "des zones de flou". Au même moment, Arnaud de Belenet se risque à un aveu plus franc encore : "Quel texte aujourd'hui, conditionne ou crée des conditions sécurisantes pour héberger les données ? Moi, je n'en connais pas. Où est-ce que vous stockez ? Dans quelles conditions ? Vous ne savez pas."

Voir aussi : "Les Américains pourront accéder à toutes les données personnelles des Européens" Eric Denécé

En guise de garantie, le texte prévoit simplement que "les opérations d'identification biométriques doivent faire l'objet d'un encadrement extrêmement strict au regard des risques encourus et être proportionnées aux modalités d'usages". Un lexique — bien connu du Sénat — ressemblant comme deux gouttes d'eau à celui qui était utilisé pour justifier les mesures sanitaires anti-Covid.

Entre les mains de l'Europe

Pour pallier le manque de "cadre juridique propre", les rapporteurs proposent de créer "une base législative explicite". Arnaud de Belenet s'avance même en assurant qu'il ne "faut pas attendre le règlement IA [intelligence artificielle, ndlr] et cranter dans la loi nationale un certain nombre d'éléments." Pour cela, le projet repose essentiellement sur les compétences de la Commission nationale de l'informatique et des libertés (CNIL), qui tiendrait le rôle de "gendarme".

Malgré tout, notamment pour s'émanciper des prestataires de services étrangers, ce projet s'inscrit dans un cadre éminemment politique et européen. D'ailleurs, l'Union a d'ores et déjà prévu l'instauration d'une gigantesque base de données pour la reconnaissance faciale, et les rapporteurs prévoient de "confier à une autorité européenne la mission d’évaluer la fiabilité des algorithmes de reconnaissance biométrique et de certifier leur absence de biais".

Lire aussi : Macron envisage le "démantèlement" de Facebook et la suppression de l'anonymat en ligne

La réalisation du projet reposera à n'en point douter sur les prochaines décisions européennes, notamment en matière de contrôle des acteurs privés. À ce sujet, l'Union continue de travailler sur le "Digital Services Act", un projet visant à mieux réguler les GAFAM et à redorer la souveraineté européenne. En parallèle, la Commission planche toujours sur son passeport numérique. Le gouvernement français suit le mouvement et se place au premier rang de la casse, ayant d'ores et déjà instauré une application d'identité numérique fin avril 2022, pour "faciliter l'accès à des services publics comme privés".

Alors, si tant est qu'à l'avenir, nous puissions être protégés de la mainmise des GAFAM, pourrions-nous pour autant avoir confiance en l'Union européenne ? Quoi qu'il en soit, avec Emmanuel Macron à la tête du pays pour les cinq prochaines années, il y a fort à parier que la France ira dans son sens — cadre législatif ou pas.

NDLR : cet article a été mis à jour le 12 mai à 12 h 00.

À LIRE AUSSI

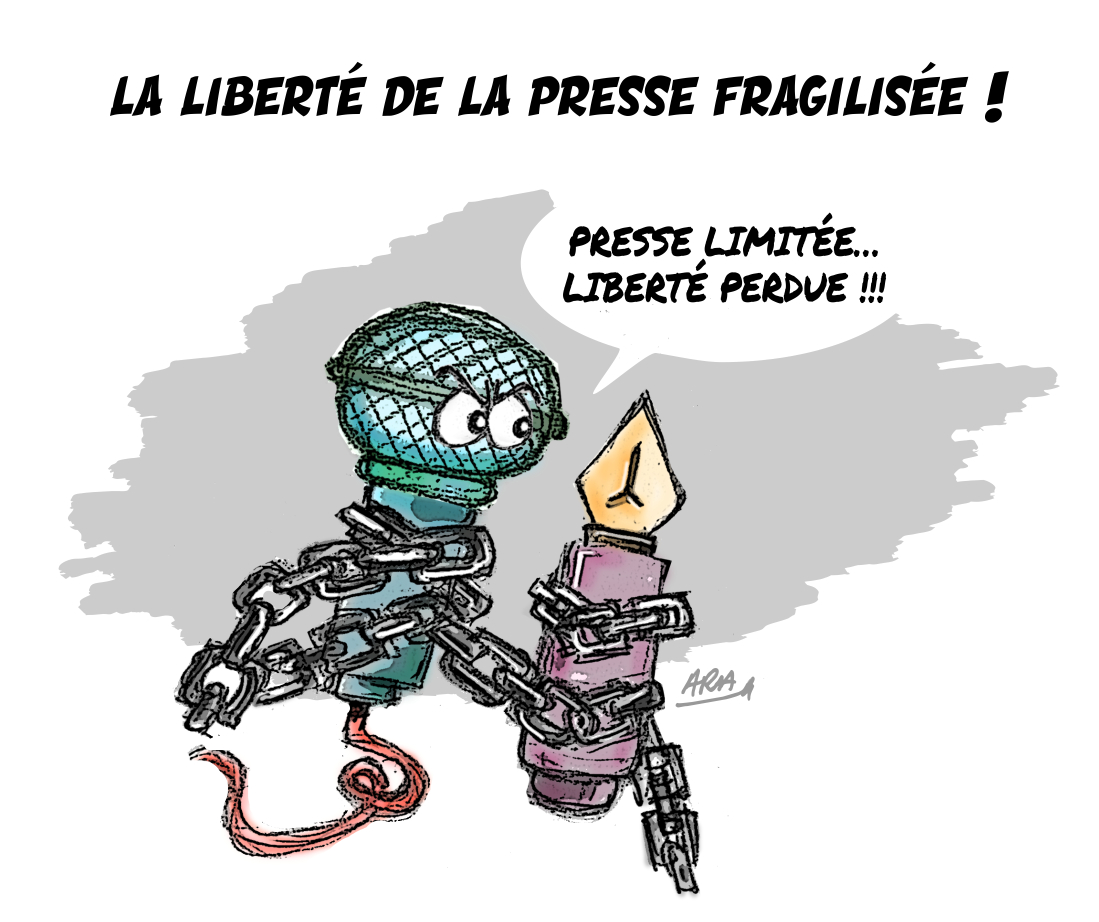

L'article vous a plu ? Il a mobilisé notre rédaction qui ne vit que de vos dons.

L'information a un coût, d'autant plus que la concurrence des rédactions subventionnées impose un surcroît de rigueur et de professionnalisme.

Avec votre soutien, France-Soir continuera à proposer ses articles gratuitement car nous pensons que tout le monde doit avoir accès à une information libre et indépendante pour se forger sa propre opinion.

Vous êtes la condition sine qua non à notre existence, soutenez-nous pour que France-Soir demeure le média français qui fait s’exprimer les plus légitimes.

Si vous le pouvez, soutenez-nous mensuellement, à partir de seulement 1€. Votre impact en faveur d’une presse libre n’en sera que plus fort. Merci.