Lutte contre la pédopornographie : Apple répond aux craintes concernant le respect de la vie privée

Quelques jours après l'annonce d'un système de détection automatique des contenus pédopornographiques sur ses appareils, Apple s'empresse de calmer le tollé. Pour limiter les abus potentiels, l'entreprise prévoit un seuil de correspondance avec des images issues de bases de données gérées par différents États avant d'agir.

Une technologie pour scanner du contenu potentiellement pedopornographique

Alors que depuis des années Apple met en avant la confidentialité comme un avantage par rapport à ses concurrents, le 6 août dernier, la marque de smartphones a informé du déploiement d’une solution pour repérer contenus pédopornographiques présents sur les iPhones et iPads, solution déjà mise en place par ses concurrents. Apple a expliqué que la technologie serait capable de scanner les images et vidéos des utilisateurs directement sur leurs appareils pour détecter des contenus pédopornographiques. Appelé "NeuralMatch", le système analysera en permanence les photos stockées sur le téléphone et sur l’iCloud. À travers l’assistant numérique Siri, et la messagerie, la société pourrait également détecter des faits de maltraitance des enfants. S'il s'avère qu'un utilisateur possède du contenu audio, photo, vidéo ou texte, Apple sera alerté, pour procéder à un examen humain pour vérifier le contenu, puis signalera l'utilisateur aux forces de l'ordre.

Selon les critiques, la technologie conçue par Apple pour détecter la propagation de la pédopornographie serait un outil intrusif de surveillance

Pour les experts, le balayage non consensuel des photos et son analyse par machine learning ne permettra pas de résoudre le problème, et cette technologie pourrait être utilisée pour suivre des choses autres que la pedopornographie. Pour Eva Galperin, directrice de la cybersécurité de l'Electronic Frontier Foundation (EFF), un tel système d'analyse qui ne serait soit disant utilisé que pour les images sexuellement explicites impliquant des enfants, est impossible à concevoir.

Un auditeur indépendant pour superviser les nouvelles mesures contre l’abus sexuel d'enfants

Apple a expliqué avoir prévu une formation de ses employés sur la façon de traiter les questions des consommateurs concernés, et a fait appel à un auditeur indépendant pour superviser les nouvelles mesures pour la regulation de matériel d'abus sexuel d'enfants. Apple a également précisé vendredi que le système ne signalerait que les utilisateurs ayant environ 30 images potentiellement illicites ou plus. Apple a également répondu aux préoccupations concernant les gouvernements espionnant les utilisateurs ou traçant des photos qui ne sont pas de la pornographie enfantine. L’entreprise a déclaré que sa base de données serait composée d'images provenant de plusieurs organisations de sécurité des enfants, pas seulement du Centre national pour les enfants disparus et exploités, comme cela avait été initialement annoncé. La société prévoit également d'utiliser les données de groupes dans des régions gérées par différents gouvernements et a déclaré que l'auditeur indépendant vérifiera le contenu de sa base de données. Apple a aussi déclaré qu'il refuserait toute demande des gouvernements d'utiliser sa technologie comme moyen d'espionner les clients. Le système est disponible uniquement aux États-Unis et ne fonctionne que si un utilisateur a activé le service Photos iCloud.

Les experts, pas rassurés par les mesures de contrôle d’Apple

L’EFF n'a pas été rassuré par le processus de supervision de la technologie, car, selon la fondation, cela n' empêchera pas de saper le cryptage qui protège la vie privée des utilisateurs. "Tout système qui permet la surveillance affaiblit fondamentalement les promesses du cryptage".

À LIRE AUSSI

L'article vous a plu ? Il a mobilisé notre rédaction qui ne vit que de vos dons.

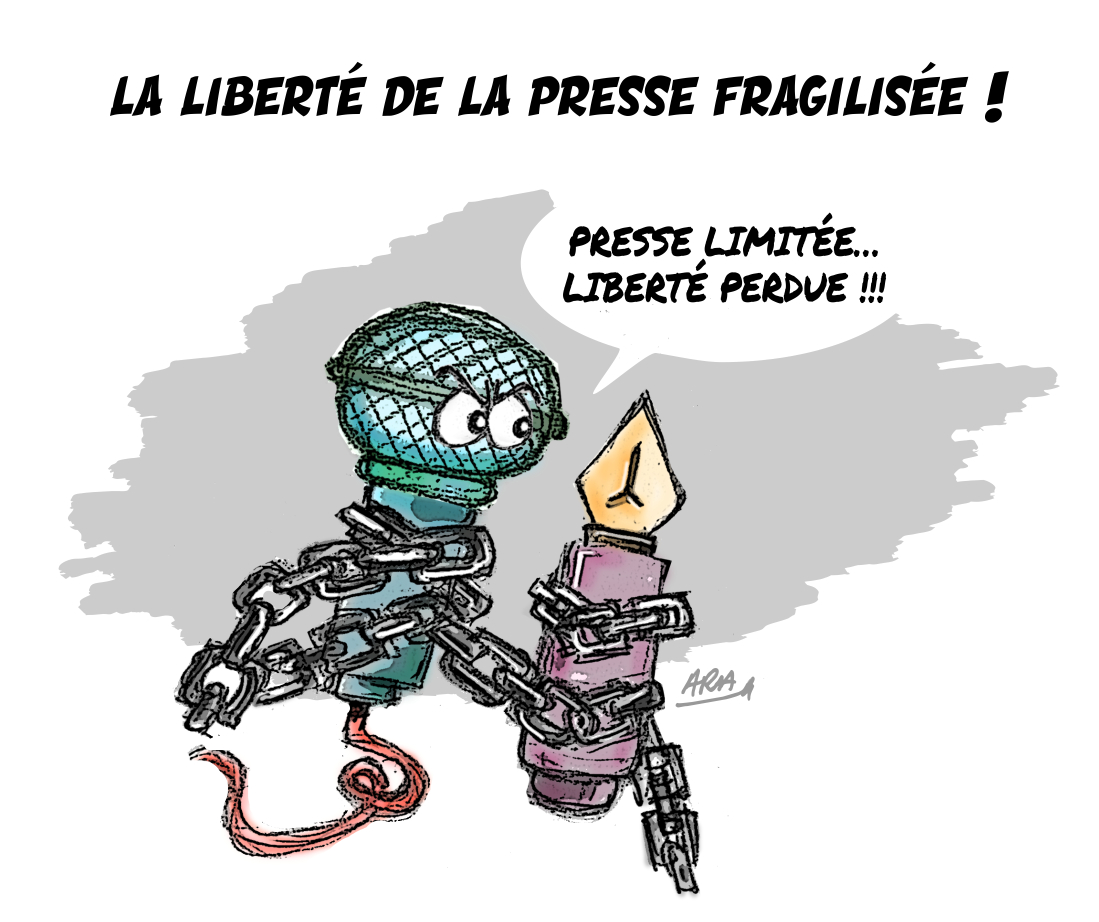

L'information a un coût, d'autant plus que la concurrence des rédactions subventionnées impose un surcroît de rigueur et de professionnalisme.

Avec votre soutien, France-Soir continuera à proposer ses articles gratuitement car nous pensons que tout le monde doit avoir accès à une information libre et indépendante pour se forger sa propre opinion.

Vous êtes la condition sine qua non à notre existence, soutenez-nous pour que France-Soir demeure le média français qui fait s’exprimer les plus légitimes.

Si vous le pouvez, soutenez-nous mensuellement, à partir de seulement 1€. Votre impact en faveur d’une presse libre n’en sera que plus fort. Merci.