IA guerrière : Des bombardements programmés en masse et un fusil-robot automatisé

L'IA va nous en faire voir de toutes les couleurs. Pendant qu'Israël utilise des programmes "intelligents" pour doper ses offensives contre le Hamas, comme l'a rappelé Julian Assange récemment, un ingénieur américain s'est amusé à fabriquer un fusil d'assaut robotisé augmenté par ChatGPT.

The Time publiait un article sur le sujet en décembre dernier : "The Gospel" et "Lavender" sont deux programmes d'intelligence artificielle, respectivement capables de suggérer des bâtiments à bombarder et d'identifier des membres potentiels du Hamas pour les éliminer. Ce qui fait dire à Julian Assange que "la majorité des cibles à Gaza sont bombardées grâce à l’intelligence artificielle", et a donné lieu aux bombardements les plus meurtriers du 21e siècle. On n'arrête pas le progrès.

De son côté, un ingénieur américain connu sous le nom de STS 3D sur Instagram a décidé de tester les limites de ChatGPT par le biais d'un fusil robotisé. En l’espace de quelques secondes, et à l’aide de simples ordres vocaux, il parvient à activer une arme à feu automatisée, capable de tirer en rafale selon des instructions précises. Dans une vidéo - visionnée plus de 12 millions de fois et relayée par BFM TV-, l’inventeur montre les prouesses de son petit Terminator, qui réagit avec une rapidité inquiétante. "Bon travail, tu nous as sauvé", lance-t-il à ChatGPT, comme si c'était un jouet.

Cet incident a heureusement suscité une réaction immédiate d'OpenAI. L'entreprise l'a tout simplement banni. "Nous avons identifié de manière proactive cette violation de nos politiques", a déclaré OpenAI au média Futurism. Pour l'instant, la politique de l’entreprise interdit formellement l'utilisation de ses modèles pour créer des armes. Mais cette ligne de défense semble tout de même floue, surtout après un assouplissement des règles en janvier 2024. Ce n’est pas un cas isolé : déjà en janvier, une autre utilisation malveillante de ChatGPT avait défrayé la chronique, avec la planification d'un attentat à la voiture piégée à Las Vegas. La question est toujours la même : comment réguler une technologie qui évolue plus vite que ses normes ?

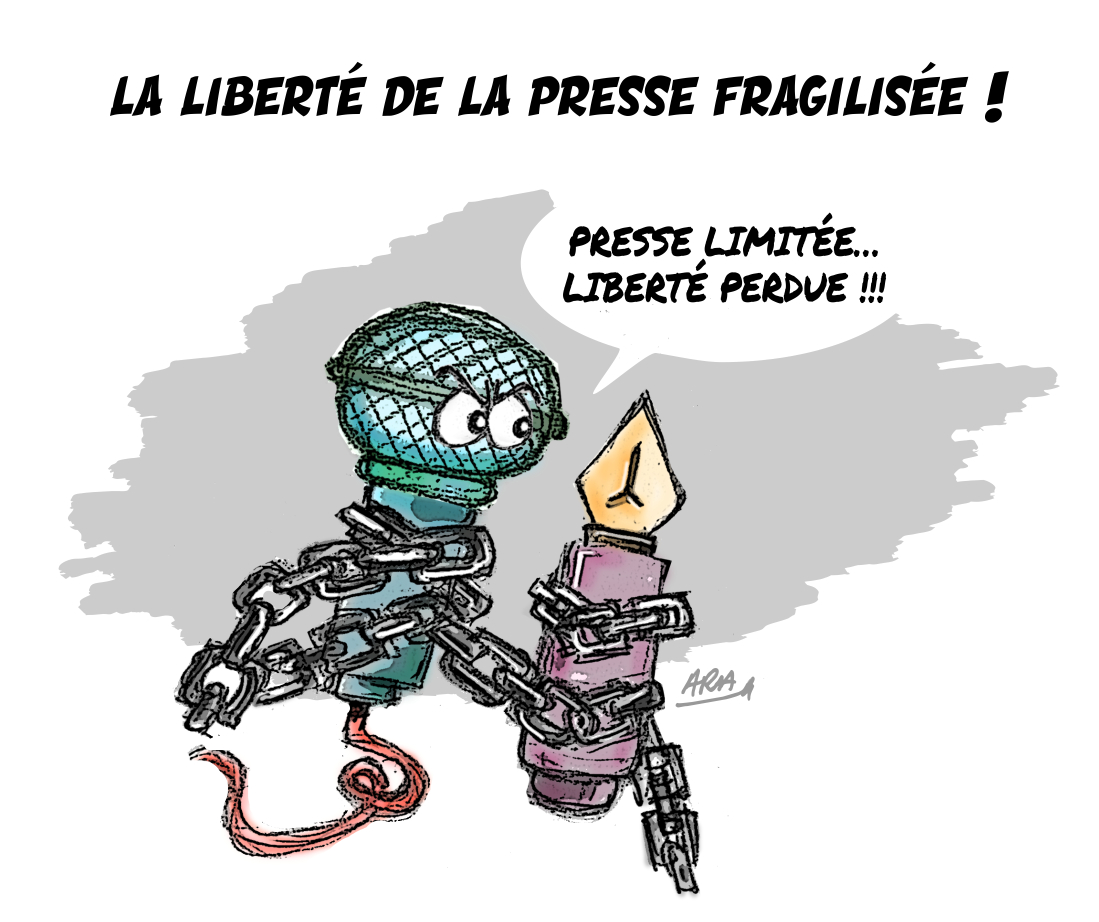

L'article vous a plu ? Il a mobilisé notre rédaction qui ne vit que de vos dons.

L'information a un coût, d'autant plus que la concurrence des rédactions subventionnées impose un surcroît de rigueur et de professionnalisme.

Avec votre soutien, France-Soir continuera à proposer ses articles gratuitement car nous pensons que tout le monde doit avoir accès à une information libre et indépendante pour se forger sa propre opinion.

Vous êtes la condition sine qua non à notre existence, soutenez-nous pour que France-Soir demeure le média français qui fait s’exprimer les plus légitimes.

Si vous le pouvez, soutenez-nous mensuellement, à partir de seulement 1€. Votre impact en faveur d’une presse libre n’en sera que plus fort. Merci.